Bruxelles – Se la strada dopo il voto in commissione sembrava spianata, l’ultimo ostacolo all’avvio dei triloghi sul Regolamento Ue sull’intelligenza artificiale è comparso proprio all’ultimo metro. Il Partito Popolare Europeo ha presentato una serie di emendamenti al testo concordato con le altre forze dell’Eurocamera in vista del voto in sessione plenaria di domani (14 giugno), per tentare di far rientrare dalla finestra un divieto già incluso nella relazione degli eurodeputati adottato appena un mese fa: quello sull’utilizzo del riconoscimento biometrico negli spazi pubblici per questioni di sicurezza.

“Il testo è chiaro, è all’avanguardia, teniamolo come licenziato in commissione per portarlo ai triloghi”, è stata l’esortazione del co-relatore Brando Benifei (S&D), a cui a fatto eco il collega Dragoş Tudorache (Renew Europe): “Invito tutti a votare con responsabilità, sapendo che siamo dalla parte giusta della storia”. Gli appelli a non disgregare il fronte creatosi lo scorso 11 maggio durante la votazione decisiva delle commissioni per il Mercato interno e la protezione dei consumatori (Imco) e per le Libertà civili, la giustizia e gli affari interni (Libe) è arrivato nel corso del confronto di oggi (13 giugno) in sessione plenaria del Parlamento Ue. Fra meno di 24 ore gli eurodeputati saranno chiamati a esprimersi sul via libera alla posizione dell’Eurocamera sul Regolamento sull’intelligenza artificiale, e il modo in cui voteranno sugli emendamenti prima e sul testo finale poi metterà in chiaro se e con quale forza i due co-relatori andranno a negoziare con le controparti del Consiglio dell’Ue.

Al centro del nuovo braccio di ferro all’Eurocamera sulla relazione sull’intelligenza artificiale c’è il divieto permanente all’uso di dettagli biometrici per riconoscere le persone in spazi accessibili al pubblico (impronte digitali, Dna, voce, andatura), che nella riunione congiunta delle commissioni Imco e Libe era passato a larga maggioranza con 58 voti a favore 36 contrari e 10 astenuti. Ma come anticipato durante il briefing pre-plenaria della settimana scorsa, gli eurodeputati del Ppe hanno deciso di non rispettare la promessa di votare il testo in plenaria così come presentato e domani potrebbero presentarsi con un ordine di voto contrario al testo finale se non passerà l’emendamento sull’esclusione del riconoscimento biometrico dalla lista di applicazioni inaccettabili dell’intelligenza artificiale. In questo scenario – al momento ipotetico – non è comunque da dimenticare che il risultato potrebbe dipendere anche dal numero di eurodeputati assenti durante la votazione per presenziare ai funerali di Stato dell’ex-premier italiano Silvio Berlusconi. Non solo il presidente del Ppe, Manfred Weber, ma anche un numero non irrilevante di popolari europei (a partire dalla delegazione italiana) si recherà a Milano, disertando i lavori a Strasburgo.

Nel corso del dibattito in plenaria l’olandese Jeroen Lenaers ha rivendicato che “con l’intelligenza artificiale si possono tutelare i cittadini, serve un approccio realistico”, anche grazie all’emendamento del Ppe sull’uso del riconoscimento biometrico “in situazione circoscritte per trovare i minori scomparsi, contrastare la criminalità e il terrorismo“. Parole ribadite anche dal tedesco Andreas Schwab, che ha negato di volere una “sorveglianza illimitata” e ricordando che “abbiamo chiesto anche in commissione una votazione distinta sul riconoscimento biometrico per le applicazioni di intelligenza artificiale, non è un attacco alle spalle”. La svedese Arba Kokalari ha chiesto apertamente ai colleghi di “votare sì perché la polizia possa mettere fine al terrorismo e alla tratta di minori”. Ma se la posizione del Ppe rischia di spaccare la ‘maggioranza Ursula’ sul Regolamento sull’intelligenza artificiale, lo stesso si può dire per un possibile fronte delle destre. Perché da una parte c’è Identità e Democrazia favorevole – “Non abbiate timore a usarlo per prevenire reati come il terrorismo internazionale”, ha esortato Alessandro Panza (Lega) – ma dall’altra trova contrari buona parte dei membri del gruppo dei Conservatori e Riformisti Europei: “Con queste deroghe prima prenderemo di mira i terroristi, ma poi pian piano tutti potremmo essere messi sotto sorveglianza”, ha avvertito l’olandese Rob Rooken.

Duri i socialdemocratici e i Verdi sulla posizione del Ppe. “Sono preoccupato per gli emendamenti che annacquano tutto quello che abbiamo concordato, al punto che ora le proposte sono vuote”, ha attaccato Petar Vitanov (S&D). “Bisogna rispettare gli accordi presi”, ha avvertito i popolari Sergey Lagodinsky (Verdi/Ale). Gli stessi co-relatori hanno cercato di richiamare alla responsabilità tutti i gruppi che sostengono la proposta: “L’uso di queste telecamere non ha nessun beneficio provato sulla sicurezza dei cittadini, mentre sono provati i rischi di abusi e discriminazione”, ha messo in chiaro Benifei, parlando anche di “rischio per la tenuta democratica dei nostri Paesi”. Con il via libera dalla plenaria “ci batteremo con il Consiglio per difendere questo approccio e contrastare i pericoli per la nostra libertà, penso alle parole preoccupanti di alcuni ministri degli Interni, compreso quello italiano”. Un riferimento esplicito a quanto già ricordato dallo stesso eurodeputato un mese fa a proposito della volontà del ministro Matteo Piantedosi di introdurre il riconoscimento facciale nei luoghi pubblici, in contrasto con la moratoria che lo vieta fino alla fine del 2023. “Tutte le autorità pubbliche devono operare entro determinati confini anche nel garantire la sicurezza”, ha aggiunto Tudorache.

Il testo in votazione sull’intelligenza artificiale

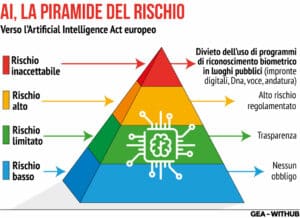

Il testo che sarà sottoposto a votazione – emendamenti esclusi – è incentrato sulla scala di rischio per regolamentare le applicazioni di intelligenza artificiale, su quattro livelli di rischio: minimo (videogiochi abilitati per l’Ia e filtri anti-spam), limitato (chatbot), alto (assegnazione di punteggi a esami scolastici e professionali, smistamento dei curriculum, valutazione dell’affidabilità delle prove in tribunale, chirurgia assistita da robot) e inaccettabile (tutto ciò che rappresenta una “chiara minaccia per la sicurezza, i mezzi di sussistenza e i diritti delle persone”, come l’assegnazione di un ‘punteggio sociale’ da parte dei governi). Per il primo livello non è previsto alcun intervento, mentre l’ultimo livello sarà vietato integralmente.

Secondo la posizione dell’Eurocamera i sistemi di intelligenza artificiale che presentano un livello di rischio inaccettabile per la sicurezza delle persone saranno severamente vietati, compresi i sistemi che utilizzano tecniche subliminali o manipolative intenzionali, sfruttano le vulnerabilità delle persone o sono utilizzati per il social scoring. La partita degli emendamenti si giocherà sull’inclusione in questo elenco anche di sistemi di identificazione biometrica remota in spazi accessibili al pubblico sia in tempo reale sia a posteriori, sistemi di categorizzazione biometrica che utilizzano caratteristiche sensibili (sesso, etnia, cittadinanza, religione, orientamento politico) e dai social media o dalle telecamere a circuito chiuso per creare database di riconoscimento facciale. Ma anche sistemi di polizia predittivi (basati su profili, localizzazione o comportamenti criminali passati) e software di riconoscimento delle emozioni anche nella gestione delle frontiere, nei luoghi di lavoro e nelle istituzioni educative.

Secondo la posizione dell’Eurocamera i sistemi di intelligenza artificiale che presentano un livello di rischio inaccettabile per la sicurezza delle persone saranno severamente vietati, compresi i sistemi che utilizzano tecniche subliminali o manipolative intenzionali, sfruttano le vulnerabilità delle persone o sono utilizzati per il social scoring. La partita degli emendamenti si giocherà sull’inclusione in questo elenco anche di sistemi di identificazione biometrica remota in spazi accessibili al pubblico sia in tempo reale sia a posteriori, sistemi di categorizzazione biometrica che utilizzano caratteristiche sensibili (sesso, etnia, cittadinanza, religione, orientamento politico) e dai social media o dalle telecamere a circuito chiuso per creare database di riconoscimento facciale. Ma anche sistemi di polizia predittivi (basati su profili, localizzazione o comportamenti criminali passati) e software di riconoscimento delle emozioni anche nella gestione delle frontiere, nei luoghi di lavoro e nelle istituzioni educative.

Per quanto riguarda l’alto rischio, gli eurodeputati hanno ampliato la classificazione prevista dall’Artificial Intelligence Act, includendo danni alla salute, alla sicurezza, ai diritti fondamentali o all’ambiente, così come sistemi di intelligenza artificiale che possono influenzare gli elettori nelle campagne politiche e nei sistemi di raccomandazione utilizzati dalle piattaforme di social media (secondo quanto previsto dal Digital Services Act). Nell’uso generale dei sistemi Ia, i fornitori dovranno garantire una solida protezione dei diritti fondamentali, ridurre i rischi e rispettare i requisiti di progettazione, registrandosi nella banca dati dell’Ue. A proposito dei modelli di fondazione generativa come ChatGpt, gli eurodeputati chiedono il rispetto dei requisiti di trasparenza e la pubblicazione dei dati protetti da copyright utilizzati per l’addestramento. Per promuovere l’innovazione sono state invece inserite esenzioni per le attività di ricerca e per i componenti dell’IA forniti con licenze open-source. A monitorare su tutto l’impianto dell’Artificial Intelligence Act ci sarà l’Ufficio Ue per l’Ia, il cui ruolo è stato riformato dal Parlamento Ue.

![[credits: Jonathan Raa / IPA agency]](https://www.eunews.it/wp-content/uploads/2026/02/IPA_Agency_IPA61174527-120x86.jpg)