dall’inviato a Strasburgo – L’Atto Ue sull’intelligenza artificiale è quasi pronto per entrare in vigore dopo il via libera definitivo del Parlamento Europeo questa settimana (ora manca solo l’ok del Consiglio), ma il lavoro non è certo finito. Non solo per quanto riguarda i passi per l’implementazione del nuovo Regolamento con le scadenze per l’introduzione degli obblighi sugli usi e gli sviluppi delle nuove tecnologie, ma anche per i prossimi passi del lavoro legislativo. “Potremmo fare delle scelte ulteriori con una direttiva che guardi agli obiettivi da raggiungere sugli usi dell’intelligenza artificiale nei luoghi di lavoro, ci sono diversi elementi che potremo inserire”, anticipa in un’intervista a Eunews il co-relatore per il Parlamento Europeo sull’Atto Ue sull’intelligenza artificiale, Brando Benifei (Pd), sottolineando le possibili direttrici dell’azione futura dell’Unione e le sfide maggiori che il Regolamento si appresta ad affrontare.

Abbiamo visto già ora, con l’accordo tra Microsoft e la start-up francese Mistral, le forti pressioni che possono essere esercitate a proposito dei modelli di fondazione ad alto impatto. Il nuovo Regolamento è all’altezza per affrontare queste sfide?

Abbiamo visto già ora, con l’accordo tra Microsoft e la start-up francese Mistral, le forti pressioni che possono essere esercitate a proposito dei modelli di fondazione ad alto impatto. Il nuovo Regolamento è all’altezza per affrontare queste sfide?

“L’accordo trovato è di livello su questo fronte, perché prevede un’alta protezione rispetto a ciò che ci eravamo posti come problema. Cioè il fatto che fossero tutelate non solo le persone, ma anche le imprese che utilizzeranno i modelli di fondazione per lo sviluppo dei propri sistemi e che oggi hanno bisogno di certezze sulla sicurezza e sul funzionamento di questi modelli più potenti. Di fronte alle pressioni lobbistiche molto forti che ci sono state, per interesse della pubblica opinione andrà capito meglio cosa si è mosso e anche perché, mentre c’era un accordo in corso, Mistral ci chiedeva di rilassare le regole per aiutare i nuovi sviluppatori europei.

È un interrogativo che ci fa pensare che forse ci fossero altri interessi dietro questo tipo di pressione sì legittima, ma comunque molto forte. Che, va detto, non ha sortito alcun effetto, perché il testo finale è assolutamente chiaro nel prevedere un percorso da parte dell’Ufficio Ue per l’intelligenza artificiale dentro uno schema chiaro di principi per la sicurezza dei modelli più potenti, compreso il tema dell’impatto ambientale che è stato molto osteggiato. Questo passerà da una supervisione del Parlamento Europeo, che nella nuova legislatura dovrà verificare l’applicazione corretta del Regolamento e che la Commissione faccia i passi esecutivi necessari”.

Questo lavoro potrebbe passare anche da nuove direttive Ue sull’intelligenza artificiale più specifiche?

“Sì, ma più che per i modelli fondativi, direi più in generale per l’applicazione dell’uso dell’intelligenza artificiale nei luoghi di lavoro, in particolare per ciò che non può essere normato con un Regolamento per ragioni di competenze non piene dell’Unione Europea sul tema lavoro. Ci sono diversi obiettivi che una direttiva potrebbe considerare, come obblighi più stringenti di coinvolgimento delle parti sociali per la contrattazione e per le scelte che riguardano elementi di sicurezza e formazione obbligatoria.

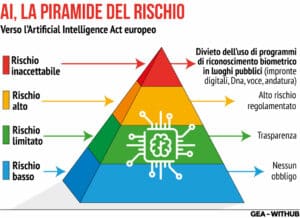

Già nel Regolamento ci sono comunque norme importanti per i lavoratori. Non solo l’applicazione del principio della classificazione dell’intelligenza artificiale nell’ambito dei luoghi di lavoro come ad alto rischio, o ancora il divieto dell’uso di sistemi di riconoscimento delle emozioni, ma anche il fatto che tutti i lavoratori dovranno sapere che un sistema di intelligenza artificiale è in uso nel proprio luogo di lavoro, con informazioni e coinvolgimento delle parti sociali. Tutte cose che non c’erano nel testo originario e che abbiamo costruito con il lavoro parlamentare”.

Che tipo di impatto avrà il Regolamento a livello di costi per le imprese del settore tech?

“Abbiamo creato delle sandbox apposite per ridurre i costi in entrata per i nuovi attori sul mercato e che vogliono sviluppare il proprio modello di business. Potranno entrare nel mercato senza dover immediatamente rispettare tutte le norme del Regolamento, ma soltanto quando saranno pienamente pronti, in maniera accompagnata e con costi di conformità ridotti soprattutto in fase di avvio. Questo per noi è importante per dare la possibilità alle nuove imprese di concorrere allo stesso livello dei grandi attori già presenti nel mercato. Non c’è dubbio che i costi per le nuove imprese e start-up saranno contenuti grazie a queste azioni, ma serve anche una politica di sostegno economico. Oltre alle norme, l’Unione Europea e i Paesi membri dovranno costruire anche modelli di sostegno, per esempio immaginiamo un sistema di incentivazione economica per la conformità anticipata alle norme prima che diventino pienamente obbligatorie. Aumentare la desiderabilità dell’applicazione anticipata e volontaria è un tema di adesso, è qualcosa che dovrebbe iniziare subito”.

A proposito del Regolamento, quanto è preoccupante un possibile ricorso da parte degli Stati membri delle eccezioni post-remoto e in tempo reale per l’uso estensivo dei sistemi di riconoscimento biometrico, soprattutto quando si parla di minacce terroristiche?

A proposito del Regolamento, quanto è preoccupante un possibile ricorso da parte degli Stati membri delle eccezioni post-remoto e in tempo reale per l’uso estensivo dei sistemi di riconoscimento biometrico, soprattutto quando si parla di minacce terroristiche?

“Abbiamo dovuto aprire a trovare un accordo in trilogo ad alcuni utilizzi. Anche se il testo finale vede una restrizione molto più forte rispetto al testo originario della Commissione, e quindi molto più vicino a quello del Parlamento Europeo e distantissimo dai desiderata del Consiglio: oggettivamente è stata una vittoria del Parlamento, ma è chiaro che non è la posizione che avevamo votato per un divieto totale. Alla fine le eccezioni previste sono limitate e sono attivabili solo con una decisione di un magistrato e sotto la supervisione dell’autorità di protezione dei dati, con una notifica immediata.

Nel caso della minaccia terroristica ‘specifica e attuale’, il contesto è molto ben delimitato. I termini utilizzati nel Regolamento fanno riferimento a una definizione restrittiva del concetto di ‘minaccia terroristica’ basato sulla giurisprudenza della Corte di Giustizia dell’Unione Europea. Perciò gli abusi, che sono sempre possibili, sono evidentemente tali e potranno essere bloccati dalla magistratura. Questo concetto non può mai essere usato in chiave preventiva, non può essere utilizzato per cercare dei potenziali terroristi. L’atto terroristico deve essere già avvenuto oppure, in una casistica molto ristretta, deve esserci la certezza e l’imminenza dell’attacco”.

Il governo italiano stava spingendo per l’utilizzo di programmi di riconoscimento biometrico in luoghi pubblici. Teme che possa ancora tirare dritto con questo approccio restrittivo?

“Potrebbe provarci, ma non potrebbe farlo, perché dopo sei mesi dall’entrata in vigore del Regolamento l’uso delle telecamere biometriche in tempo reale in spazi pubblici – se non per le casistiche limitatissime descritte – e anche la giustizia predittiva saranno vietate. Sono tutte cose su cui il ministro Piantedosi aveva avviato sperimentazioni, ma si dovranno fermare. Non è un caso se quello italiano è stato uno dei governi che ha fatto maggiori resistenze sull’Atto Ue sull’intelligenza artificiale”.

![Il presidente della Russia, Vladimir Putin. Contro di lui l'Ue poteva fare di più in termini di sanzioni, ammette la Commissione europea [foto: imagoeconomica]](https://www.eunews.it/wp-content/uploads/2025/01/Imagoeconomica_2357584-120x86.jpg)